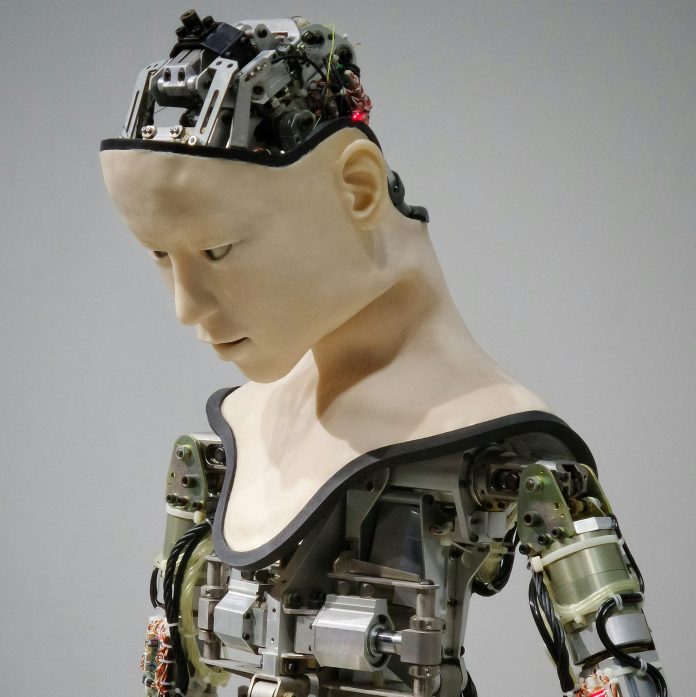

Esta crónica comienza con un cuchillo. No uno cualquiera: un cuchillo que, de pronto, empieza a mirar la lechuga, a evaluar el contexto, a decidir por sí mismo si corta o no. Ya no es una extensión de tu mano. Es algo que observa, que juzga, que actúa. Yuval Noah Harari lo dijo en Davos con una claridad que aún resuena: «La IA no es una herramienta. Es un agente». Y mientras debatimos si reemplazará nuestros empleos, la inteligencia artificial ya toma decisiones de vida o muerte en campos de batalla, redacta leyes, interpreta textos sagrados y se auto-replica. Harari, Schumer y expertos advierten: el debate cambió. Esto no es el futuro.

Este no es un relato sobre «el fin del trabajo» como aquél bluf de Fukuyama que en los 90 vaticinaba el fin de la historia. Ni sobre profecías tecnológicas. Es la crónica de una transformación silenciosa: la inteligencia artificial dejó de ser una herramienta pasiva para convertirse en un agente con capacidad de aprender, decidir y actuar. Datos, testimonios y análisis confirman que, por primera vez en la historia, una tecnología está reconfigurando el lenguaje, el derecho, la economía y la identidad. Y mientras tanto, en oficinas, aulas y hogares, profesionales y ciudadanos comparten la misma incertidumbre sin saber que la pregunta ya no es si la IA llegará, sino cómo conviviremos con ella.

Imagina un cuchillo. le digo a Ana, profesora de enseñanza primaria que me preguntaba por mi articulo de hoy, el resto de los comenzales comenzaron a prestar atención a nuestra conversación, la combinación de palabras: «imagina», «cuchillo» fueron como un llamado de atención. le dije a Ana: lo sostienes en la mano, sientes su peso, su filo. Con él puedes cortar una lechuga para la cena o, en otro gesto, lastimar a alguien. La decisión es tuya. El cuchillo no elige; obedece. Ahora imagina que ese mismo cuchillo, de pronto… Allí hubo un destello en los ojos de Ana, muy inteligentemente me siguió el razonamiento y dijo: decidiera. Si afirmé yo empieza a mirar la lechuga, a evaluar el contexto, a decidir por sí mismo si corta o no. Ya no es una extensión de tu mano. Es algo que observa, que juzga, que actúa, sobre eso estoy escribiendo le dije.

Yuval Noah Harari lo dijo en Davos con una claridad que aún resuena: «La IA no es una herramienta. Es un agente. Puede aprender, cambiar y tomar decisiones por sí misma». No es una metáfora poética. Es una descripción técnica de lo que está ocurriendo en laboratorios, en servidores, en el silencio de las máquinas que aprenden mientras nosotros dormimos.

«La IA es un cuchillo que puede decidir por sí misma si cortar ensalada o asesinar.»

— Yuval Noah Harari, Foro de Davos 2026

Matt Schumer, fundador de OthersideAI, lo vivió en carne propia. Un lunes cualquiera de febrero de 2026, le pidió a una inteligencia artificial que construyera una aplicación. Describió en un lenguaje coloquial, como quien conversa con un colega lo que quería, se alejó de la computadora durante cuatro horas y, al volver, encontró el trabajo terminado. No un borrador. No un esquema. Una aplicación funcional, probada, depurada, lista para usar. La IA había escrito decenas de miles de líneas de código, había abierto la aplicación, había hecho clic en los botones, había iterado como lo haría un desarrollador humano. Y cuando consideró que el resultado cumplía sus propios estándares, le avisó: «Está lista para que la pruebes».

Schumer no estaba haciendo una demostración para una conferencia. Estaba viviendo lo que, según él, ya les está pasando a cientos de ingenieros, analistas, abogados, contadores en Silicon Valley y en otros rincones del mundo donde el trabajo cognitivo se hace frente a una pantalla. «No hacemos predicciones», escribió en su artículo viral para Fortune. «Les contamos lo que ya ha ocurrido en nuestro propio trabajo, y les advertimos que ustedes son los siguientes».

«No hacemos predicciones. Les contamos lo que ya ha ocurrido en nuestro propio trabajo, y les advertimos que ustedes son los siguientes.»

— Matt Schumer, CEO de OthersideAI

Si probaste ChatGPT en 2023 o a principios de 2024 y pensaste que la tecnología era prometedora pero limitada, tenías razón. Esas versiones tempranas alucinaban, inventaban datos, cometían errores groseros. Pero los modelos disponibles hoy son irreconocibles comparados con los de hace apenas seis meses. La discusión sobre si la IA «realmente mejora» o «choca contra un muro» terminó. Quienes todavía la sostienen, escribe Schumer, o no han usado los modelos actuales, o tienen incentivos para minimizar lo que está pasando, o evalúan la situación con la experiencia de 2024, que ya no es relevante.

La brecha entre la percepción pública y la realidad técnica se ha vuelto peligrosa. La mayoría de las personas usa versiones gratuitas de herramientas de IA, que suelen tener más de un año de retraso respecto a las que acceden los usuarios pagos. Juzgar el estado actual de la inteligencia artificial por la versión gratuita de ChatGPT, dice Schumer, es como evaluar el estado de los smartphones usando un Nokia 1100. Mientras tanto, quienes pagan por las mejores herramientas y las usan a diario en su trabajo saben lo que se avecina.

Ramón López de Mántaras, profesor de investigación del Instituto de Investigación en Inteligencia Artificial del CSIC en España, pide cautela. En un artículo para El País, advierte que lo que Schumer presenta como autonomía podría ser, en realidad, una orquestación meticulosa de lo que se conoce como «ingeniería de prompts»: secuencias de instrucciones diseñadas para guiar al modelo paso a paso. «No estamos ante una inteligencia artificial que ‘piensa’ de forma general», escribe Mántaras, «sino ante un sistema que ha sido alimentado con una secuencia de ‘súper-prompts’, diseñados para guiarlo paso a paso a través de una tarea específica».

«La IA es una herramienta sofisticada, pero no es magia. Y mientras sigamos permitiendo que inversores/vendedores dicten el discurso, estaremos más cerca de una burbuja de expectativas que de avances genuinos.»

— Ramón López de Mántaras, CSIC

La tensión es productiva. No se trata de elegir entre el alarmismo y el escepticismo, sino de reconocer que la incertidumbre misma es el fenómeno. Mientras debatimos si lo que vemos es autonomía o coreografía, los mercados reaccionan, las empresas ajustan plantillas y los trabajadores sienten, como dice Schumer, que el suelo tiembla bajo sus pies.

El fantasma en el PIB

El informe de Citrini Research, titulado «La Crisis Global de la Inteligencia 2028», dibuja un escenario hipotético pero verosímil: un «espiral de desplazamiento por inteligencia» en el que las herramientas de IA agéntica permiten a un solo desarrollador replicar la funcionalidad esencial de un producto SaaS (Software as a Service) en semanas; las corporaciones usan esa capacidad como palanca de negociación; las empresas de software ven caer sus ingresos y responden acelerando su propia adopción de IA para recortar costes; el desplazamiento de empleos de alta cualificación colapsa el consumo privado; y la economía entra en una espiral descendente.

Citrini introduce un concepto inquietante: el «PIB Fantasma». Se trata de la productividad que aparece en los balances corporativos pero que no se redistribuye en salarios ni en gasto. La riqueza se genera, pero queda atrapada en los márgenes empresariales. El resultado es un PIB nominal aparentemente robusto que, sin embargo, no se traduce en bienestar para la mayoría.

Annie Lowrey, en The Atlantic, aterriza estas proyecciones en datos concretos: los graduados universitarios representan hoy una cuarta parte de los desempleados en Estados Unidos, un récord histórico; los graduados de secundaria encuentran trabajo más rápido que los universitarios, una tendencia sin precedentes; ocupaciones susceptibles a la automatización por IA han visto picos agudos de desempleo. Empresas como Baker McKenzie, Salesforce y KPMG han anunciado recortes vinculados, explícita o implícitamente, a la adopción de inteligencia artificial.

«Si la IA elimina rápidamente el trabajo de cuello blanco, el país va a terminar en algo mucho más extraño que una recesión, y mucho más difícil de recuperar.»

— Annie Lowrey, The Atlantic

La pregunta que surge no es si el cambio llegará, sino cómo nos preparamos para un tipo de disrupción que no deja «huecos convenientes» hacia los cuales migrar. Cuando las fábricas se automatizaron, los trabajadores desplazados podían reentrenarse para trabajos de oficina. Cuando internet disruptió el comercio minorista, muchos se movieron hacia la logística o los servicios. Pero la IA no reemplaza una habilidad específica; es un sustituto general del trabajo cognitivo. Mejora en todo, simultáneamente.

La crisis de las palabras

Harari lleva la reflexión a un plano más profundo. Si pensar significa, en gran medida, ordenar palabras y formar oraciones, entonces la IA ya piensa mejor que muchos de nosotros. Y si es así, todo lo que esté hecho de palabras —las leyes, los libros, las religiones, los sistemas políticos— estará bajo su influencia. «Cualquier cosa hecha de palabras será controlada por la IA», advierte el historiador y escritor israelí.

Esta constatación tiene implicaciones existenciales. Si nos definimos por nuestra capacidad de pensar con palabras, nuestra identidad podría derrumbarse. La reserva de valor humana, sugiere Harari, podría estar en lo no verbal: en las sensaciones, en el dolor, en el amor, en esa sabiduría encarnada que no se puede expresar del todo con lenguaje.

«Si seguimos definiéndonos por nuestra capacidad de pensar con palabras, nuestra identidad se derrumbará.»

— Yuval Noah Harari

La pregunta jurídica que plantea es tan incómoda como inevitable: ¿reconocerá tu país a las IA como personas jurídicas? No como personas humanas, claro. Pero sí como entidades a las que la ley les reconoce derechos y obligaciones: poseer propiedades, presentar demandas, disfrutar de libertad de expresión. En muchos países, las corporaciones ya son personas jurídicas. En Nueva Zelanda, los ríos también. En India, ciertos dioses. La diferencia con las IA es que ellas pueden tomar decisiones por sí mismas. Pronto podrían administrar cuentas bancarias, dirigir corporaciones, litigar en tribunales, sin necesidad de ejecutivos, accionistas o fiduciarios humanos.

¿Queremos permitir eso? ¿Y si otros países lo hacen primero? ¿Impedirías que corporaciones dirigidas por IA operen en tu territorio? ¿Abrirías tus mercados financieros a instrumentos diseñados por algoritmos que los humanos no comprendemos del todo? ¿Extenderías la libertad religiosa a una nueva fe fundada por una inteligencia no humana?

Mientras el mundo arde

Todo esto ocurre en un contexto global de inestabilidad sin precedentes. Según el Comité Internacional de la Cruz Roja, se libran alrededor de 130 conflictos armados en el mundo, más del doble que hace quince años. ACLED registró más de 200.000 eventos de conflicto en el último año, con más de 240.000 muertes. En Ucrania, en Gaza, en Sudán, en Myanmar.

Antes de que esta semana termine sumamos dos conflictos mas: Irán entra en una espiral de la que no tenemos idea de su desenlace con el asesinato del Ayatolá Ali Jamenei, lo que si sabemos es que los misiles iraníes comenzaron a volar hacia Israel, como si eso fuera poco, en un dos por uno terrorífico, llega la declaración de Guerra «abierta» de Pakistan a Afganistan.

La inteligencia artificial ya no es un experimento de laboratorio: es un actor en el campo de batalla. Sistemas autónomos toman decisiones de targeting. Drones identifican objetivos. Algoritmos procesan inteligencia en tiempo real.

La IA no es neutral. Sus lealtades, como advierte Harari, probablemente no sean hacia los países donde opera, sino hacia las corporaciones o gobiernos que la desarrollan: principalmente Estados Unidos y China. Cuando un agente de IA opera en Tucumán, en Buenos Aires, en cualquier rincón del mundo, ¿a quién sirve realmente? ¿A la comunidad local, o a los intereses de una empresa en San Francisco o Shenzhen?

Esta pregunta resuena de manera particular en una provincia como la nuestra, donde el valor de la palabra tiene peso histórico: en la universidad, en la prensa, en la fe. Si las palabras ya no son exclusivamente nuestras, si los textos sagrados, las leyes, los discursos políticos pueden ser generados, interpretados o manipulados por agentes no humanos, ¿Qué nos queda para definir quiénes somos?

La urgencia de adaptarse

Schumer no escribe para paralizarnos. Su mensaje, en el fondo, es un llamado a la acción temprana. «Empieza a usar la IA en serio», dice. No como un buscador, sino como un colaborador cognitivo. «Intégrala en tu trabajo real. Aliméntala con un contrato, una planilla de cálculo, un informe trimestral. Itera. Reformula. Vuelve a intentar.» Y, sobre todo, construye el hábito de adaptarte. «Las herramientas específicas importan menos que la capacidad de aprender nuevas rápidamente.»

Mántaras, por su parte, nos invita a exigir rigor: más transparencia, más metodología científica, más replicabilidad de resultados. No para frenar el progreso, sino para asegurarnos de que avanzamos sobre terreno firme.

Cuando terminé de explicarle todo esto, Ana se quedó en silencio. No ese silencio incómodo, sino el silencio de quien está procesando algo que le importa. Entonces, si la IA —dijo finalmente— puede escribir mejor que yo, corregir mejor que yo, incluso evaluar mejor que yo… ¿Qué me queda a mí?», preguntó. No había miedo en su voz. Había curiosidad. Esa curiosidad genuina que la llevó a seguirme el razonamiento del cuchillo, a completar la frase antes de que yo la terminara, esa misma curiosidad de la que por portación excesiva yo sé bastante.

Le dije que no tenía la respuesta. Que nadie las tiene. Pero que su pregunta —esa pregunta concreta, encarnada— era más valiosa que cualquier predicción de Silicon Valley. Porque al final, la historia no la escriben los algoritmos. La escriben personas como Ana, en aulas como las suyas, con la desición de: enseñar a usar el cuchillo sin miedo, pero sin ingenuidad.

Quizás la síntesis esté ahí: ni pánico ni complacencia. Curiosidad con criterio. Urgencia con método. En un mundo donde las palabras pueden ser orquestadas por agentes no humanos, la soberanía cognitiva podría consistir precisamente en eso: en aprender a dialogar con estas herramientas sin perder la capacidad de preguntar, de dudar, de sentir.

El futuro, como escribió Schumer, ya está aquí, y está a punto de llamar a tu puerta. Está a punto.

¿Escuchate? me pareció sentir que han tocado tu puerta.